從AI基礎架構到在地生態系,全面加速企業AI落地

隨著生成式AI與大型語言模型(LLM)快速發展,企業數位轉型已從「導入AI工具」進入「建構AI能力體系」的新階段。AI不再只是單點應用,而是需要整合AI基礎架構、資料治理、模型應用與營運流程的核心引擎。

在此趨勢下,企業競爭關鍵已從單一技術能力,轉向是否具備端到端AI解決方案(End-to-End AI Solution)與完整生態系整合能力。HPE慧與科技透過整合Private Cloud AI、企業級運算平台與在地AI夥伴,協助企業建立可擴展、可治理且可持續優化的AI營運基礎。

挑戰|AI導入三大關鍵瓶頸:建置速度、成本與治理能力

1. AI基礎建設門檻高,建置周期長

傳統資料中心需整合運算、儲存、網路與冷卻系統,導致AI基礎架構建置周期動輒數月以上,難以快速回應生成式AI需求。

2. 模型導入與應用落地成本高

企業在導入LLM與生成式AI應用時,需同時考量硬體資源、模型選型與系統整合,前期投資與技術門檻高。

3. AI治理與資料主權需求提升

隨著《人工智慧基本法》與資料合規要求升高,企業需在安全、可控與資料不外流的前提下導入AI,增加部署複雜度。

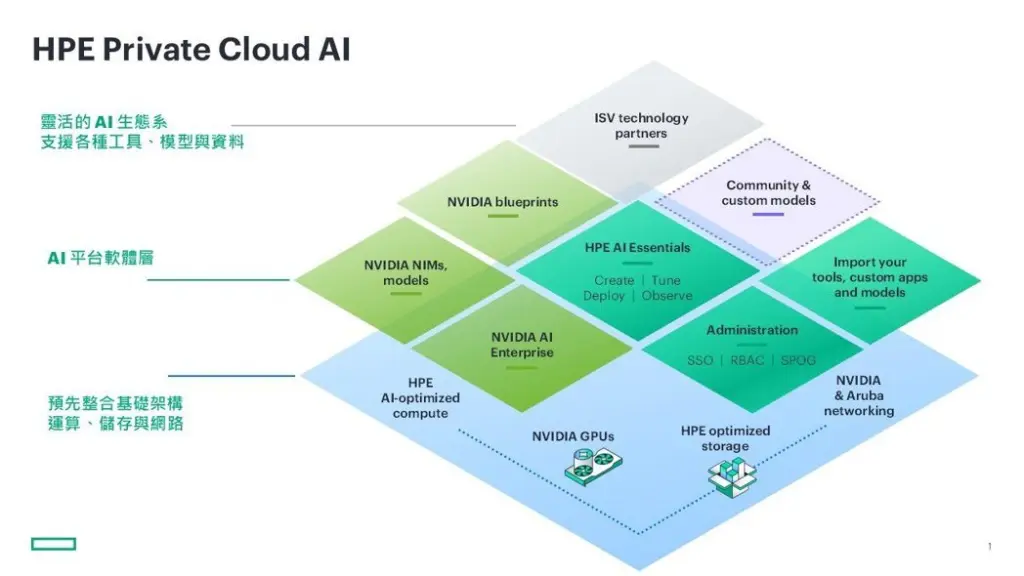

解決方案|HPE Private Cloud AI × 生態系整合,打造企業級AI平台

HPE提出以HPE Private Cloud AI為核心的端到端企業AI解決方案,整合AI基礎架構、平台服務與在地夥伴,協助企業從模型訓練到生成式AI應用部署,建立完整AI生命周期管理能力。

HPE整合以下核心基礎設施,打造企業級AI運算底座:

- HPE ProLiant伺服器與Cray超級運算系統

- NVIDIA GPU加速平台與NVLink高速互連技術

- 高效能儲存平台與AI軟體工具整合

此架構可同時支援LLM訓練、推論、多模型部署與資料密集型AI應用,滿足企業從PoC到大規模AI落地的需求。

模組化AI超算中心|Modular Supercomputing Center

針對企業AI導入速度需求,HPE推出Modular Supercomputing Center(模組化AI超算中心),將電力、冷卻、運算與管理系統整合於模組化資料中心架構中。

此架構具備三大優勢:

- 建置周期縮短至數月內完成

- 降低資料中心建置與整合複雜度

- 支援彈性擴充,隨AI算力需求成長

讓企業能快速取得高效能AI運算環境,縮短AI專案落地時間。

快速建構生成式AI平台|LLM Appliance

在生成式AI需求快速成長下,HPE與合作夥伴推出LLM Appliance解決方案,協助企業快速建立專屬GenAI環境。

平台支援:

- 主流大型語言模型(GPT、Gemini、Claude、Llama)

- RAG(Retrieval-Augmented Generation)企業知識庫建構

- 應用場景包含:AI客服、文件生成、知識搜尋

搭配HPE GreenLake AI即服務(AIaaS)模式,企業可依需求彈性配置算力,從小型應用到大型AI平台皆可靈活部署,降低前期投資壓力。

從AI導入到AI營運,建立可持續競爭優勢

透過HPE端到端AI解決方案,企業可實現:

- 部署效率提升:模組化架構縮短建置周期(數月內完成)

- 成本結構優化:GreenLake按需付費降低CAPEX壓力

- AI應用加速落地:LLM與RAG快速導入業務場景

- 資料安全與合規提升:地端部署確保資料主權

- 整體營運效率提升:AI能力融入日常流程,轉化為持續生產力

未來展望|三位一體架構,推動企業AI自主化

HPE指出,企業AI成功的關鍵,在於建立「可持續演進的能力體系」,而非單次導入專案。HPE持續擴展台灣AI生態系,整合多元在地夥伴,涵蓋:

- AI應用與平台開發:雅婷智慧、APMIC、凌羣電腦、云碩科技

- 智慧製造與數位孿生:和碩、大同世界科技

- AI視覺與資料分析:大猩猩科技、光禾感知

- 資料治理與AI合規:炬識科技

形成完整的企業AI應用生態系(AI Ecosystem)。

透過:

- AI基礎架構(Infrastructure)

- 生成式AI平台(Platform)

- 在地服務生態系(Ecosystem)

三位一體整合,企業可逐步建立AI自主能力(AI Sovereignty),讓AI從工具升級為企業核心營運能力。

未來,HPE將持續深化與台灣AI夥伴的合作,推動跨產業AI應用落地,協助企業在生成式AI與AI Agent時代中,建立長期競爭優勢。

報導來源:經濟日報 https://hpe.pse.is/8ukxle